Apa itu Perseptron

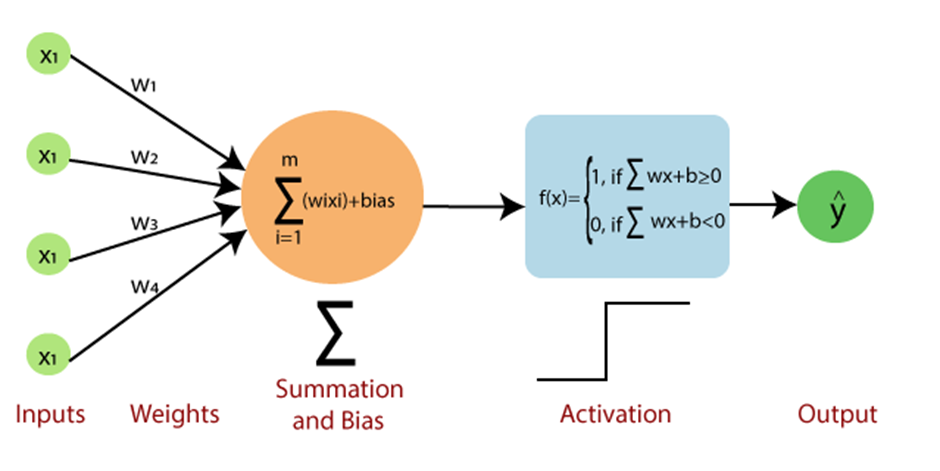

Perseptron adalah model sederhana namun kuat yang terinspirasi oleh perilaku neuron biologis dalam otak. Ini adalah blok dasar untuk jaringan saraf buatan dan berfungsi sebagai dasar untuk memahami arsitektur deep learning yang lebih kompleks.

Perseptron terdiri dari beberapa komponen utama, termasuk node input, bobot, bias, dan fungsi aktivasi. Node input menerima nilai input, dan bobot dan bias menentukan kekuatan dan arah koneksi. Fungsi aktivasi bertanggung jawab untuk mentransformasikan jumlah berbobot dari input menjadi output.

-

Node Input

Node input mewakili fitur atau variabel dari data input. Pada perseptron sederhana, setiap node input sesuai dengan satu fitur. Node input mengirimkan nilai mereka ke lapisan berikutnya dalam jaringan, dikalikan dengan bobot yang sesuai. -

Bobot

Bobot adalah nilai numerik yang menunjukkan kekuatan dan arah koneksi antara node input dan keluaran perseptron. Selama proses pembelajaran, bobot disesuaikan untuk meminimalkan kesalahan antara keluaran yang diprediksi dan sebenarnya. -

Bias

Bias adalah parameter tambahan yang memungkinkan perseptron menggeser batas keputusan. Ini bertindak sebagai offset, memungkinkan perseptron untuk mempelajari hubungan yang lebih kompleks antara fitur input dan keluaran. -

Fungsi Aktivasi

Fungsi aktivasi memproses jumlah berbobot dari input, menghasilkan nilai output. Pilihan fungsi aktivasi berpengaruh signifikan pada perilaku dan kemampuan pembelajaran perseptron.

Difference between perceptron and neuron?

Algoritma Pembelajaran Perceptron

Algoritma pembelajaran perceptron menyesuaikan bobot dan bias berdasarkan kesalahan antara keluaran aktual dan diprediksi. Algoritma dapat dirangkum sebagai berikut:

- Inisialisasi bobot dan bias dengan nilai acak.

- Untuk setiap input dalam dataset pelatihan, hitung jumlah berbobot dari input dan lewatkan melalui fungsi aktivasi untuk memperoleh keluaran yang diprediksi.

- Hitung kesalahan antara keluaran yang diprediksi dan aktual.

- Perbarui bobot dan bias menggunakan kesalahan dan tingkat pembelajaran.

- Ulangi langkah 2-4 sampai perseptron konvergen ke solusi atau kriteria berhenti yang telah ditentukan tercapai.

Algoritma pembelajaran perceptron adalah contoh dari pembelajaran terawasi, karena memerlukan dataset dengan contoh yang diberi label untuk melatih model. Ini juga merupakan contoh dari pembelajaran online, karena bobot dan bias diperbarui secara bertahap setelah setiap contoh input.

Perseptron dalam Deep Learning

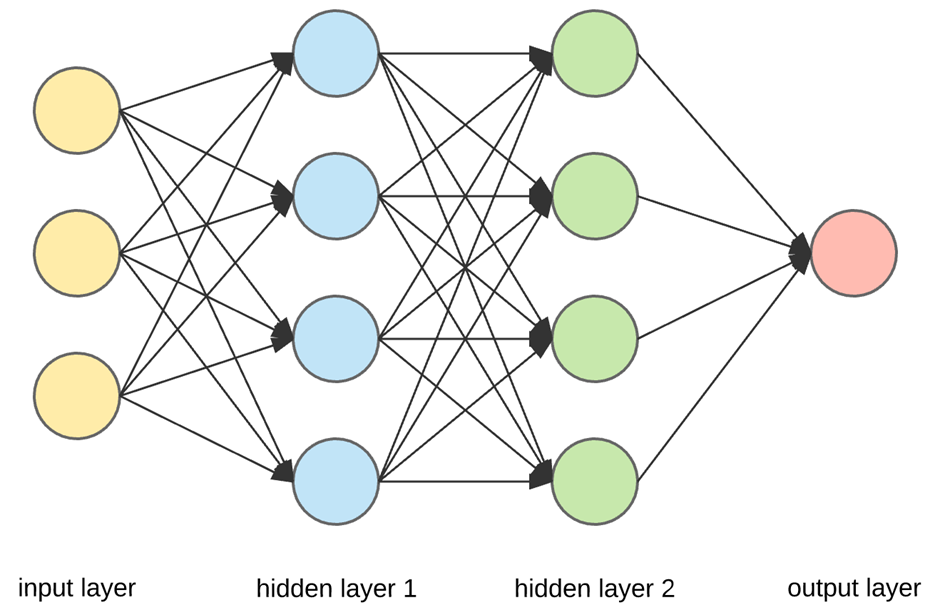

Perseptron memainkan peran dasar dalam deep learning, berfungsi sebagai blok bangunan untuk arsitektur yang lebih canggih. Dalam bab ini, saya akan menjelajahi bagaimana perseptron diorganisir dalam model deep learning, membahas perseptron multi-layer (MLP), dan menguji proses pelatihan deep MLP menggunakan backpropagation.

Lapisan Perseptron

Dalam deep learning, perseptron diorganisir menjadi lapisan. Setiap lapisan dapat mengandung beberapa perseptron, dan ada tiga jenis lapisan utama:

-

Lapisan Input

Lapisan input menerima data mentah dan terdiri dari node input sebanyak fitur dalam dataset. Lapisan ini tidak melakukan perhitungan apa pun; hanya mentransmisikan nilai input ke lapisan berikutnya. -

Lapisan Tersembunyi

Lapisan tersembunyi memproses dan mentransformasikan informasi dari lapisan input. Model deep learning dapat memiliki beberapa lapisan tersembunyi, memungkinkan model untuk mempelajari representasi yang semakin kompleks dan abstrak dari data input. Setiap lapisan tersembunyi berisi beberapa perseptron, yang dapat bervariasi tergantung pada arsitektur dan masalah yang sedang dipecahkan. -

Lapisan Output

Lapisan output menghasilkan prediksi atau klasifikasi akhir. Jumlah node output tergantung pada tugas. Untuk klasifikasi biner, satu node output sudah cukup, sementara tugas klasifikasi atau regresi multikelas mungkin memerlukan beberapa node output.

Lapisan Perseptron

Difference between perceptron and neuron?

Perseptron Multi-Layer (MLP)

MLP adalah jaringan saraf maju yang terdiri dari beberapa lapisan perseptron. Istilah "majukan" menunjukkan bahwa informasi mengalir dalam satu arah melalui jaringan, dari lapisan input ke lapisan output, tanpa ada loop.

Fitur utama MLP adalah kemampuannya untuk mempelajari dan merepresentasikan hubungan non-linear yang kompleks antara input dan output. Berbeda dengan perseptron satu lapisan, yang hanya dapat mempelajari batas keputusan linier, MLP dapat mendekati fungsi kontinu apa pun, dengan asumsi jumlah lapisan tersembunyi dan perseptron yang cukup.

Melatih Deep MLP

Melatih deep MLP melibatkan penyesuaian bobot dan bias melalui proses yang disebut backpropagation. Algoritma backpropagation menghitung gradien kesalahan terhadap setiap bobot dan bias, yang kemudian digunakan untuk memperbarui parameter model. Algoritma dapat dirangkum sebagai berikut:

- Inisialisasi bobot dan bias dengan nilai acak.

- Lakukan penerusan melalui jaringan, menghitung jumlah berbobot dari input dan menerapkan fungsi aktivasi pada setiap lapisan untuk mendapatkan prediksi akhir.

- Hitung kesalahan antara keluaran yang diprediksi dan aktual.

- Lakukan langkah mundur melalui jaringan, menghitung gradien kesalahan terhadap setiap bobot dan bias menggunakan aturan rantai.

- Perbarui bobot dan bias menggunakan gradien yang dihitung dan tingkat pembelajaran.

- Ulangi langkah 2-5 selama jumlah epoch yang telah ditentukan atau hingga kriteria berhenti tercapai.

Backpropagation adalah contoh dari pembelajaran terawasi, karena memerlukan dataset dengan contoh yang diberi label untuk melatih model. Ini juga merupakan bentuk pembelajaran batch, karena bobot dan bias diperbarui setelah memproses seluruh dataset.

Referensi